La abogada y escritora argentina Cecilia Danesi no necesitó de la pandemia para dar un giro a su vida. Un par de años antes, abandonó todos los privilegios que tenía por haber trabajado una década y media en la Cámara Nacional de Apelaciones en lo Civil, y se dedicó de lleno a su pasión: la divulgación de la Inteligencia Artificial (IA) y sus implicancias en las cuestiones de género y derechos humanos. El salto no fue al vacío.

Se especializó en distintas universidades de España, Italia y Francia; y hoy vive en Salamanca, donde es investigadora del Instituto de Estudios Europeos y Derechos Humanos. Desde allí desarrolla tareas de docencia y dirige diferentes posgrados universitarios en el mundo, enfocada en esa Inteligencia Artificial que hoy todo lo alcanza y no parece tener finitud. Desde mostrar cómo se vería el rostro de Jesús o de las personas desaparecidas por la última dictadura, hasta ser utilizada en Educación, Salud o Ambiente. Pero también en armas autómatas. Beneficios, riesgos y alertas.

–Sin tecnisismos, ¿qué es la IA?

–La idea de la Inteligencia Artificial es que una máquina, un programa informático, una computadora, imite o emule el cerebro humano. Por eso es “inteligencia” por un lado, algo propio y exclusivo de los humanos, sin entrar en una discusión más filosófica de qué es “inteligente”; pero se trata de una inteligencia creada por el hombre, no natural. Entonces, una máquina va a imitar el cerebro humano a través de algoritmos, que son fórmulas matemáticas, números y simbolitos, que desde las Ciencias Sociales mucho no los entendemos, pero esos algoritmos van a aprender de los datos. Por eso se habla de aprendizaje automático o aprendizaje de máquina, «machine learning”. El algoritmo va a buscar patrones en esos datos y va a crear sus propias reglas, como una secuencia de pasos lógicos, un protocolo a seguir.

–¿El planeta está preparado para afrontar los desafíos de la IA de manera homogénea?

–Diría que no. No sabemos qué es lo que nos espera. Hay una incertidumbre enorme dentro de lo que son estas tecnologías emergentes, sobre todo la IA. Los más expertos e incluso quienes lo están desarrollando se sorprenden de sus avances. Es imposible de cuantificar hasta dónde va a llegar en el futuro. Entonces, desde la regulación o desde las políticas de Estado aplicadas en áreas como la Educación, por caso, siempre vamos un paso atrás.

–¿Por qué ocurre eso?

–Para poder abarcar un fenómeno social, primero hay que estudiarlo, conocerlo. El problema es que, por ejemplo, ChatGPT en tres meses quintuplicó sus habilidades. Es muy difícil estar preparado, planificar y programar lo que viene.

–¿Qué diferencia hay con la programación tradicional?

–A la programación tradicional vos le dabas las reglas y el sistema las respetaba. Siempre te iba a dar los mismos resultados. Ante un determinado “input” ya estaba preestablecido el “output”. La IA crea sus propias reglas y tiene la posibilidad de seguir aprendiendo, entonces es dinámica y totalmente imprevisible. Hoy te puede dar una respuesta y mañana frente a un mismo “input” te va a dar una respuesta distinta.

–¿Cómo se conjuga con la cuestión de género?

–Las redes sociales o las plataformas digitales, desde los motores de búsqueda hasta todos los servicios de mensajería y aplicaciones como Rappi, Globo, Uber o Airbnb que cambiaron nuestra economía, están gobernadas por algoritmos. Teniendo en cuenta que la IA forma parte de nuestra vida y aprende de nuestras conductas y de la información que le damos, absorbe tanto cosas buenas como cosas malas. Muchas veces estos algoritmos tienen una injerencia directa y sideral en cuestiones de género, de diversidad, de Derechos Humanos, de discriminación.

–Suena grave…

–Claro, todos tenemos prejuicios, sesgos, estamos criados con determinados valores y los reproducimos y aplicamos en todo lo que hacemos. El problema con la IA es que esto muchas veces es imperceptible. La mayoría de la población no sabe que todo lo que pasa en las redes sociales lo decide un algoritmo programado por una empresa privada. El poder replicador que tiene la IA es incomparable con la capacidad humana.

–Peor aún si se aplica en armas autónomas…

–En mi libro le dedico varias páginas a este tema. Es el elefante que está en la habitación pero del que nadie habla. La Unión Europea acaba de aprobar el reglamento de la IA pero no se aplica al área militar, con lo cual la regulación más avanzada justamente no aborda uno de sus mayores peligros. Hay posturas a favor y en contra. El derecho internacional humanitario, conocido vulgarmente como ‘derecho de la guerra’ que regula los conflictos bélicos, establece uno de sus principios como el de proporcionalidad. Generar el menor daño posible y evitar objetivos civiles. Todos los sistemas de IA trabajan por objetivos y el modelo va a buscar la manera más eficiente y rápida de alcanzarlo. ¿Los sistemas autónomos y los humanos cómo ponderarían esta proporcionalidad?

–¿Y vos qué creés?

– No estoy justificando su uso pero tenemos que establecer las reglas del juego sabiendo que cualquier país del mundo puede utilizar esto en el futuro y no todos tienen los mismos principios, valores, cultura e idiosincrasia que uno. Estamos en un mundo globalizado donde esto está al alcance de todos.

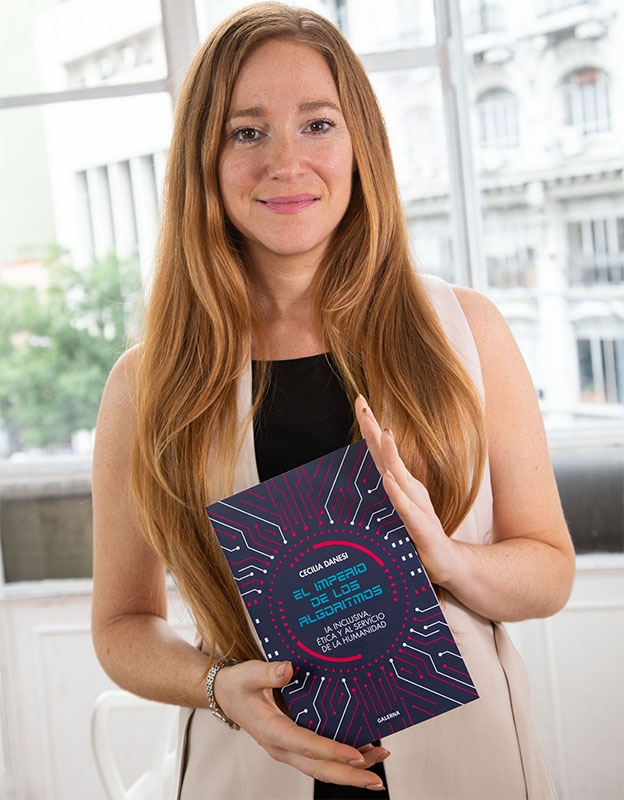

El imperio de los algoritmos y la ética

Danesi publicó en octubre pasado su último libro llamado “El imperio de los algoritmos” y desde hace años viene exponiendo y disertando en universidades u organismos estatales del mundo sobre los alcances de la Inteligencia Artificial. Sin embargo, su divulgación no se acota solo al ámbito académico: “Me encanta explicarles a las tías y las abuelas de qué se trata esto, porque creo que el conocimiento es para todas las personas y no sólo para algunos. La idea es que el conocimiento se transmita desde distintos lugares”, explica la abogada e investigadora, quien resume que “la IA es transdisciplinaria, transgeneracional. No es un compartimento estanco”. Dice que “la IA no se puede frenar” y si bien reconoce que “viene a reemplazar a ciertas profesiones y nos tenemos que reconvertir, tiene un montón de utilizaciones muy buenas. Yo soy una defensora de la IA ética”.

Juan Carlos Barreto

30 July 2023 - 11:36

En las declaraciones de la especialista hay impresiones y vaguedades: como por ejemplo la IA puede crear sus propias reglas, falso; La IA funciona en términos de criterios de lógica aristotélica es decir combina predicados y le asigna un valor de verdad, no hay entonces posibilidad de crear nuevas reglas; los algoritmos utilizados son siempre polonomiales ; lineales , quiere decir eso, no hay aprendizaje de máquina hay reorganización de predicados, eso lo hace un niño pequeño y no es un signo de aprendizaje, podrían criticarse otros aspectos, lo que sucede es que los dispositivos de IA, tienen capacidades de búsqueda que superan en un factor 1000 o más la capacidad humana de búsqueda, y además lo que va a suceder es que el conocimiento, que es poder va democratizar, y va a cambiar de manos ese es el verdadero peligro que acecha a las actuales elites